投稿日:2022年1月12日 / 更新日:2022年2月13日

(参加者)

今給黎隆(編集幹事、東京工芸大学)

伊藤彰教(編集委員、東京工科大学)

(司会)三宅陽一郎(理事、立教大学)

・text:鴫原盛之(ゲームメディアSIG代表、フリーランス)

三宅:皆様、本日はよろしくお願いいたします。今回は「ゲーム技術」をテーマに、研究者の今給黎先生、伊藤先生をお招きして、鼎談形式でお話を伺います。

今給黎:東京工芸大学芸術学部ゲーム学科の今給黎です。ゲームの開発・研究について教えております。ゲーム学科では、その名のとおりゲームが好きな学生が集まってプログラム、企画、デザインの各分野に分かれて活動するとともに、チームデザインも行いながらゲーム作りを学ぶ体制になっております。

伊藤:東京工科大学メディア学部特任講師を担当しております、伊藤と申します。私はゲームに限らないサウンドデザインの研究をしつつ、同じく東京工科大学の三上(浩司)先生、安原(広和)先生などとともに、学部生のゲーム制作の演習なども行っております。

三宅:私は立教大学大学院人工知能科学研究科で特任教授をしております、三宅です。専門はデジタルゲームの人工知能で、20年ほど研究を続けています。まず本題に入る前に、皆さんから、それぞれの専門分野のオーバービューをお話いただきまして、以降はフリートークで進めていければと思います。

今給黎:私の研究分野はコンピューターグラフィックス、特にゲームに関してのリアルタイムのコンピューターグラフィックスです。私自身は、最近は特にこれと言った成果は出していないのですが、どちらかと言えば分野全体に対して、「最近は特にこんな発展があるよ」ということを、図でご紹介させていただこうかと思います。

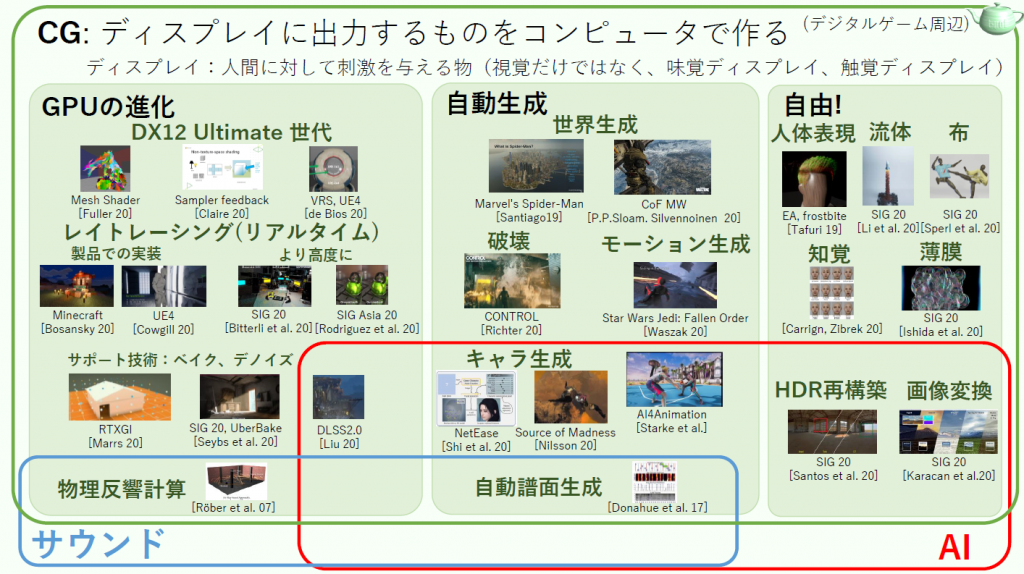

図1:今給黎氏の研究分野

コンピューターグラフィックス、ディスプレイと言えば、コンピューターで作ったものを出すみたいなイメージがあるかもしれませんが、実際に出力するのは目に対して訴えるものだけではなくて、例えば味覚や触覚など、いろいろな「人間に対して刺激を与えるもの」をディスプレイとして考え、このようなディスプレイに出力するためにコンピューターで作ったものが、いわゆるコンピューターグラフィックスの研究が対象としている領域になります。また、サウンドとAIとの関係についてですが、実際にはサウンドを作り出すものも、コンピューターグラフィックスの1分野として研究されていて、その下地として最近ではAIが広く使われるようになっています。

最近のデジタルゲーム周辺のコンピューターグラフィックスに関して、どのような研究が行われているかを見ていきたいと思います。リアルタイムのコンピューターグラフィックスの進化は、GPUの進化と歩調と合わせていろいろな研究が進んでおり、GPUに新しい機能が追加されると、それを生かしたものを研究してみたり、もしくは新しい機能が搭載されそうになると、実際に搭載された場合にはどんなことが起こるのかを研究することが、特にデジタルゲーム関連におけるコンピューターグラフィックスの研究では行われています。

具体的には、近年ではDirectX12のUltimate世代と呼ばれるようなものが最新のGPUになっており、これを用いたメッシュシェーダーやサンプラーフィードバック、バリアブルレートシェーディングのような機能を、どのように利用してどんな新しい表現を作っていくのか、もしくはゲームをより美しくするのかといったことが研究されています。

最近、大きく発展したトピックスとして挙げられるのは、リアルタイムでのレイトレーシングが行われるようになってきたことです。例えば、『マインクラフト』のようなゲームや、Unreal Engine4などのゲームエンジンに、リアルタイムのレイトレーシング機能が搭載されるようになってきたということが最新の技術で、この技術を搭載したものが実際に製品化されてはいるのですが、まだまだ不十分です。本当は、もっと高品質にできるけれども、今の機能では十分に実現できないので、いろいろな学会の場で、より綺麗にするにはどのようにすればよいのかという研究、発表がされている状況です。

リアルタイムのレイトレーシングを、今のGPUで行うのはまだ難しいことから、それを補うための技術も研究されています。例えばベイク機能のように表面の計算を事前にしておいて、それをゲーム中にリアルタイムで適応させ、非常に高速で綺麗に表現するための研究が行われています。また、リアルタイムのレイトレーシングが不十分であると、かなりザラザラした画質になってしまうのですが、そのザラザラを防ぐためのデノイズという技術も発達しています。デノイズを実現するための1分野として、AIの深層学習が積極的に用いられています。GPUの進化によって物理的な計算もしやすくなってきており、これを用いてサウンド、例えば反響などの計算をGPUでリアルタイムで行うという考え方も研究されています。

CGにおける、もうひとつの近年のテーマは自動生成です。最近のゲームは、とある町や地方のひとつひとつを、かなりの品質で作り切るゲームが多くなっていますので、これらをどうすれば効率よく作れるのかという研究が発展しています。例えば『スパイダーマン』のゲームではニューヨークをそのまま再現するとか、あるいはシューティングゲームにおいて、非常に広いリアルな世界の中を自由自在に動けるものを実現させるといったことが行われております。さらに、ただ作るだけではなくて自在に破壊できて、リアルに細かく破壊できるようにするにはどうすればいいのか、しかも自動で計算して壊れるものが実際に研究され、ゲームに実装される時代になっています。

ほかにも、人間などを作る試みも行われています。今ではキャラクターの動きを、ただあらかじめ用意されたモーションを流すのではなく、環境に適応してモーションを生成するものが実装されています。例えば、『スターウォーズ ジェダイ:フォールン・オーダー』では、キャラクターが状況に応じた動きをしますし、またEAと協力して研究を行っているエジンバラ大学では、「AI for Animation」というプロジェクトで実際のバスケットボールゲームでも使えるような、非常に滑からなモーションを生成する研究が行われています。あるいは、人やモンスターの顔を生成する研究も行われています。NetEaseでは、どのようなパラメーターを適用すれば、実際にいるような人が作れるのかといった研究がAIの力、つまりディープラーニングなどを用いて研究が進められています。

このようにCGの分野では、それぞれが好きなテーマを自由に研究しており、例えば人体表現における髪の毛をポリゴンではなく、1本ずつ作っていこうという研究もあります。伝統的には、煙や水のような流体をいかに素早く、複雑なものを表現できるかという研究が行われてきた分野でもあり、ほかにも薄い布や、シャボン玉のような薄膜の表現なども古くから行われているのですが、まだまだ研究できる余地が残されています。

三宅:ありがとうございます。では、伊藤先生お願いいたします。

伊藤:私が日本デジタルゲーム学会に参加するようになったのは2014年からで、翌年から私個人、あるいは学生とともに、主にゲーム音楽の研究から始めてきました。この鼎談をご覧になっている皆さん、特に学生の方は「ゲーム音楽って、そもそも研究になるんですか?」と思われるかもしれません。ですが、実はゲームの音楽はもとより、ゲームの効果音や人の声なども、世界的に70年代から作られていて、大学での研究においても意外なことに、2000年代に入ってからいろいろな大学で始まっています。

でも、残念ながら研究を始めたのは欧米での大学が大半で、日本ではゲームが「単なる遊び」と捉えられていて、「音楽のことは、音楽大学に任せよう」ですとか、「音響的なものは工学系の学部に、そして録音やミキシングは専門学校に任せよう」といったように、音楽の世界は良くも悪くも縦割りなんです。逆に海外では、「日本のゲーム、ゲーム音楽は素晴らしい」と評価されていて、音楽は非常に分野横断的なんですね。

ここでひとつ、ご紹介したいエピソードがあるのですが、皆さんはハーバード大学やイェール大学に音楽学部があることをご存知でしたでしょうか? これは日本だと考えられないことですよね。「音楽は、音楽大学でやるものだ」というのが常識ですから。欧米ですと、いわゆる総合大学の中に音楽学部があって、日本で言えば東京大学や京都大学に音楽学部がある形になるんです。このような非常に分野横断的な研究環境の中で、ゲーム音楽に限らず、例えば、隣の席では経済学部の学生さんが、その隣には医学部の学生さんがいたりする環境下で、映画の音楽などのクラスが行われているんです。しかも、日本の小中高のように「音楽を聴いたらハイおしまい」という内容ではなく、本当に音楽家を育てるようなクラスで、経済学部や医学部とかの学生がちゃんと単位を取るんです。そんななかで音楽とテクノロジーの研究、あるいは音響工学とテクノロジーの研究というのが、欧米では素地としてちゃんとあるんですね。

私は幸い、出身大学がそれに近い分野横断的型で、音楽大学ではなかったのですが音楽研究ができまして、現在の東京工科大学メディア学部でも、日本では数少ない音楽の本格的な研究ができつつ、隣にはコンピューターサイエンスやゲーム制作を専攻する人もいる環境で育つことができまして、職場もそのような所にずっといることができています。

日本でも、21世紀になってからは、欧米のように学校がだいぶ増えてきました。東京藝術大学のような芸術系の学校が、積極的にサブカルチャーやポップカルチャーを扱うようになったのも、ここ20年のことです。ですので、これをご覧になっている大学、高校生の皆さんは、「ああいう大学に行かないと、こんなことはできないのではないか」とか、「ゲーム音楽は、専門学校でやるものではないか」とか思われるかもしれませが、大学でも研究ができるということを、ぜひ知っておいていただきたいですね。

もちろん、専門学校を否定するわけではなくて、専門学校ではそれぞれ素晴らしい専門教育をされています。特に、今回のテーマである技術、テクノロジーに関しては、ゲームの専門学校、あるいは高専の学生・教育のレベルは極めて高く、ある面では大学のレベルよりも高い技術開発をしている専門学校や高専もたくさんあります。音や音楽は非常に特殊な世界でとっつきにくい面があるかもしれませんが、今では大学、高専、専門学校でも、ゲームという枠組みの中では輝かしい未来、いろいろな進路があることを、若い人たちにお伝えしたいですね。

どんなゲーム音楽の研究があるのかということについては、日本デジタルゲーム学会で毎年夏と年度末に行われている研究発表の予稿集がホームページで公開されていますので、まずはこちらをダウンロードして読んでいただければと思います。私が学生と一緒に取り組んだ研究としては、その多くはゲーム音楽がそれぞれのゲームの中でどのように作られているのかを研究したものです。具体的には、『テイルズオブ』『モンスターハンター』『ダークソウル』『アトリエ』シリーズなど、若い人に人気のあるゲーム音楽ひとつひとつの作りや楽譜、音楽の分析を進めてきました。

三宅:ありがとうございます。では次に、私のほうからは自分の研究分野である人工知能、AIについてお話したいと思います。ゲームAIはすごくシンプルな研究分野で、それほど難しい点はありません。ゲームAIには3種類ほどありまして、まずひとつはキャラクターの頭脳に関するキャラクターAIで、キャラクターが自律的に、自分たちで意思決定をして動くものを作るAIですね。

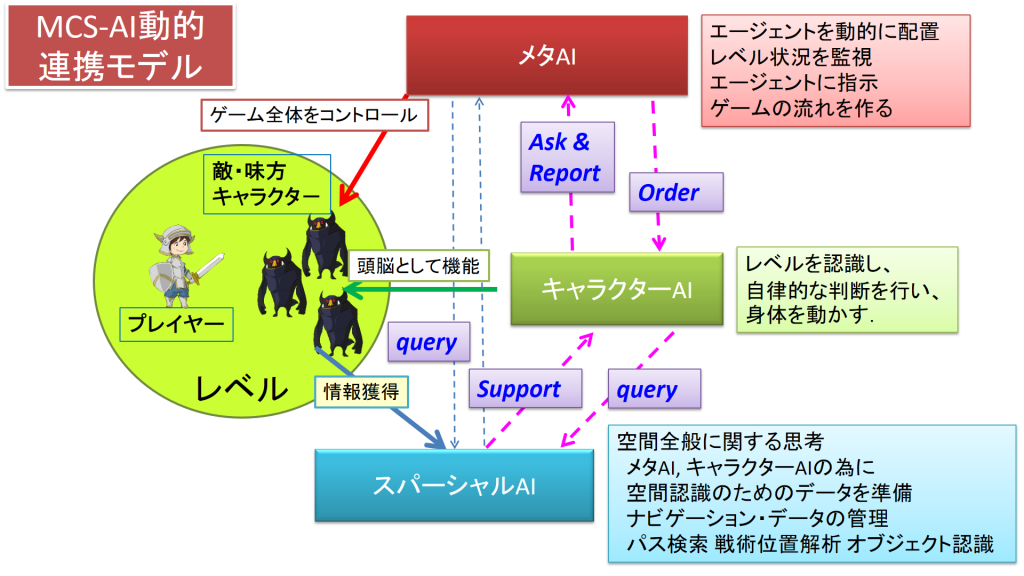

ゲームの中では、足元にたくさんの地形、あるいはオブジェクトがたくさん置いてありますが、リアルタイムでその地形を把握するためのAIをナビゲーションAIと言います。図で示したスパーシャルAIというのは私の造語で、空間認識のためのAIですね。もうひとつの重要なAIがメタAIで、ゲーム全体の神様のような存在になってバランスを取ったり、ストーリーをうまく進めてあげたりするAIですね。例えば、プレイヤーがあまり上手じゃないなと思ったら難易度を下げてあげるとか、逆に上手なプレイヤーに対しては難易度を高くしたり、ダンジョンをより複雑な構成にしたりですとか、そんなことをするのがメタAIです。

これら3種類のAIが動的に連携しながら、ゲームを作っているのがゲームAIですね。『デジタルゲーム学研究』という、我々日本デジタルゲーム学会の学会誌の最新号で、メタAIについての私の論文を掲載させていただいております。キャラクターAIもスパーシャルAIも、元々はロボティクスのAIを発祥とするものですので、すでに多くの研究成果があります。

図2:三宅氏のゲームAI発表資料

ゲームAIの本格的な研究が始まったのは1994年頃からです。それ以前のゲームは2Dでしたが、3Dになったことで3次元空間内でキャラクターみたいな複雑なものをどうやって動かすのかが、ゲームの3D化とともに研究のテーマになりまして、1994~2000年ぐらいまでの間は3Dゲームのキャラクターがよく壁とかに引っ掛かったり、穴に落ちたりしてうまく動かなかった時代だったのですが、当時から「ロボットのほうは、ちゃんと動いてるよね」ということでロボティクスのAIを導入しようという動きが、主にMITやスタンフォード大学などを中心にありました。

やがて2000年頃に、ゲーム産業とアカデミー側の双方が集まって、「ゲームAIを本格的に始めよう」という大きな会議が開かれたのですが、これがゲームAIの本格的な研究の始まりであるとされています。なかでも一番古くから研究されているのが、ロボットがどうやって道を見つけるかというナビゲーションAIで、60年代からずっと研究されています。その後、今までのような操り人形みたいなもの、つまりスクリプトAIではなくて、キャラクターを自律的に動かそうということで、キャラクターAIの研究が始まりました。

そうこうしているうちに、ゲームの規模がどんどん大規模になっていきまして、そうするとプレイヤーはどこから来るのか、あるいは敵は今どこにいるのかといった、ゲームの展開があらかじめ読めなくなってしまう、毎回違うといった問題が出てきました。そこで2005年頃から、ゲームを上から見て場を整えるためのAI、つまりメタAIが必要になってきたという流れがあります。

このように、主にこれらの3種類のAIを柱として、ゲームAIの分野が研究されています。ゲームAIの研究を始めるにあたり、もしよくわからないという場合は、まずはどれかひとつのAIから研究を始めるのがひとつの方法だと思います。

この鼎談をご覧になっている方は、おそらく皆さんゲームが好きだと思います。そこで次の質問ですが、ゲームが好きであることと、ゲームを研究することの間には、どのぐらいの距離があるかと思われますか? ゲームの研究をするにあたっては、何かほかの技術を学んでおく必要があるのでしょうか?

今給黎:私の場合は、中学生の頃からゲームが好きと言うよりは、ゲームを作るのが好きだったんです。MSXとかでゲームのプログラムを打ち込んだり、改造しているうちにゲームの世界に入ったものですから、ゲームがそれほど好きというわけではないんですね。一方で、ウチの学生はゲームがかなり好きで、学生たちを見ているとゲームが詳しいからこそ出てくる、私にはない発想をするなということは常々感じています。

ただ学生である以上、まだ勉強中の身なのでいろいろと足りてない部分はあるのですが、自分が遊んだゲームに関しては深く知っているので、だからこそ私が持っていないアイデアを出してきますね。ゲームを知っているということは、デジタルゲームの研究に関してプラスに作用する面は確実にあると思います。

三宅:なるほど。昔は『ベーマガ』とかの雑誌を見ながらゲームを作る機会が身近にありましたが、今ではUnityとかUnreal Engineとかがあって、再びゲーム開発と一般の人との距離が近付いたことで、我々が子供だった頃と似たような状況になっているのかなと思いますね。

伊藤:技術という言葉を、どういう方面で捉えるかにもよりますが、例えばギターやバイオリンのような楽器を弾ける、ドラムを上手に叩けるというのは、ひとつの技術ですよね? あるいは、何か新しい楽器を作れる、工作によって新しい楽器を作り出せるのも、これもまた技術です。何かしらを操作する、あるいは道具を作るというレベルで技術の話をするのであれば、たとえゲームのことを知らなくても本質的に工作が好きだとか、物をいろいろいじっているのが好きだという人が、多分向いているんだろうなと思いますね。特にゲームのことを知らなくても、例えば映画を撮影するのが大好きだとか、よく料理をするとか何でもいいと思いますが、これが道具という意味での技術ですね。

その一方で、ゲームはある種の表現技術であり、コミュニケーション技術だと言うこともできます。これは音楽を作ったり、絵やマンガ、小説を書いたりするのと同じだと思いますが、これらの表現ができる人は根本的にコンテンツイーター、コンテンツを食べる人と言われますよね。例えば優れた音楽家は、ほかの人よりも優れた音楽を何十倍も聴いていますし、優れた小説家であれば忙しいなかでも、たくさんの優れた小説を読んでいるわけです。

このような表現技術という点で言えば、ゲームが大好きということは、どれだけゲームというコンテンツイーティングをしているかということになりますよね。もし表現技術という意味で、何か演出技法みたいなものをやろうと思ったら、さっきとは逆で良質なゲームをたくさん食べてきた、味わってきたかというのが、むしろ必須条件になるのではないかと。ゲームをまったく知らないのにゲームが作れるのかと言えば、私は作れないのではないかと思います。

例えば優れたロックミュージシャンは、すべからく過去の偉大なロックミュージシャンたちの演奏や曲をよく知っているわけです。音大のトップクラスの学生であれば、バッハの曲を聴いたことがないという人はいないわけです。ですから、ゲームを表現として具現化するときには、名作と言われるゲームを全然触ったことがない、プレイしたことがないというのはあり得ない。

うちの大学には、どこでも入れるぐらいの優秀な留学生がたくさん来るんです。なぜ彼らが日本の東京工科大学をわざわざ選んで来るのかと言いますと、日本に行けば日本のコンテンツをいくらでも食べられるからなんですね。我々は意識していないかもしれませんが、彼らから見れば日本人はあのゲームもこのゲームも、遊び放題の夢の国に住んでいるんだそうです。

私としても、そんな環境を上手に生かして研究がしたいですし、若い人にとってもこの点に関してはすごく恵まれている、世界的に見ても憧れの国にいるんだということで、自信を持ってたくさん良いゲームに触れていただいて、その研究や制作につなげていただきたいなと思っております。

三宅:日本はゲーム大国だからこそ、すごくリッチなゲーム研究ができるハズだというのが、日本デジタルゲーム学会の趣旨でもあるんですよね。

では、次の質問に移ります。皆さんはゲームのCGや音楽を研究する意味を、どのようにお考えでしょうか? 例えば、CGであればSIGGRAPHのような大きな場がありますけども、それぞれゲーム分野に結び付けることで、ほかの研究分野とはどのような違いや特徴があって、どの辺りに境界があると思いますか?

まず、私の研究分野であるAIで言えば、AIというすごく広い分野の中でのゲームAIを研究しているということですね。ゲームAIの研究とは、簡単に言えばリアルタイムでインタラクティブなAIを研究するという意味であって、長い時間を掛けて機械学習をしたり、あるいは何かのロジックをきっちりと突き詰めていく分野とは違って、インタラクションの中での体験を作っていくという特徴がありますね。

伊藤:音大でやるような音楽理論の研究ですとか、楽曲、創作の研究というのは、原則的に音楽には始まりと終わりがあってという1曲の概念があるかと思いますが、ゲームの場合はいつ始まって、いつ終わるのかもわからない中で楽曲を作らなければいけませんし、テクノロジーも当然ながら絡んできます。

これは私の大きな夢なのですが、ゲームの中に人間のような生の演奏家や、DJプレイヤーを作れるようにしたいんですね。例えば、酒場にいるお客さんの気分が沈んでいるときは、生身の人間であればちょっとセッションをしながら盛り上げる曲を演奏しますよね? 逆に、「盛り上がり過ぎているな」と思えば、沈静化させるような落ち着いた曲を即興的に演奏するでしょう。これとまったく同じように、ゲームの中で状況に応じて楽器を弾いたりDJをするエージェントがいて、「今は緊迫感がある場面だから」と思ったら、それに合わせた曲を演奏したりするものが作れたらいいなあと。

このような技術は、すでにかなりの段階まで実現されていますが、できればこれを音符のひとつひとつのレベルで、ジャズのセッションのようにその場に応じた演奏ができる音楽エージェントを作るのが、私にとっては究極の目標なんです。その一歩前の段階である、インタラクティブミキシングというものは、ゲームの制作現場ではすでに優れた事例がたくさんあります。例えば、昼と夜とで同じ曲想の音楽でありながら、片方ではリズムパートをなくしたり、あるいは派手にしたりして、パートごとにミキシングできるようにして変化を出せるようにすることですね。このような優れた事例は、過去にもたくさんあります。

それから私が注目している、ぜひ皆さんにご紹介したいのがミュージックドーブテーリングという手法です。ドーブテールとは建築の手法で、日本語では「ありつぎ」と言うのですが、柱と柱を木で組むときに釘を使わなくてもしっかりはまるようにするものです。つまりミュージックドーブテーリングとは、音楽をパートごとに接合部があることを前提に、いつ重ねても音楽としてきちんと音楽として成立するよう、「蟻継ぎ」の要領で作曲しておく技法なんですね。

これはテクノロジーではなくて、紙とペンを使った作曲技法ですが、ゲーム音楽の中でも事実上ミュージックドーブテーリングをしている例は、すでにいくらでもあるんです。これを理論化、形式化して言語化することによって、例えばゲームAIに組み込むことができたりします。そうすると音楽の状態変化、推移のときに音楽的に破綻せず、さらにセリフと効果音も入れていけば、いろいろなドーブテーリングができるようになります。

一番難しいのは、その推移部分ですよね。例えば、戦闘が終わって平常に戻るときとか、昼から夜のシーンに切り替わるとか、ここのつなぎが非常に難しいんです。そこで音楽、あるいはサウンドのドーブテーリングを頑張って人力で分析してアルゴリズム化、あるいは形式化しておけば、最初から音符ひとつひとつを全部演奏してくれるような、音楽エージェントがいなくてもドーブテーリングによって、ある程度はあたかもゲームの中に状況がわかっているDJがいるかのような、そんな環境が実現できるのではないでしょうか。ですから、私が音楽を研究する際は、効果音を作るときも必ず音楽理論的な考え方をします。

今給黎:CGに関しては、最も有名な学会としてSIGGRAPHがあるのですが、ここでは伝統的にアルゴリズム的な話が多く、昔からいらっしゃる皆さんは、自分たちが元々CGアニメーションを全部作りたいという人が多いですよね。そこからピクサーとかが生まれて、CGの研究者だったキャットマルさんが社長になったりしたように、元々メディアとCGとの親和性が非常に高かった面があったように思います。

SIGGRAPHのなかでは、論文セッションとして通すのはかなり大変なのですが、毎年ゲームのグラフィックスの解説などもありますし、比較的理解があるのかなと思います。ただ、最近の論文などを見ますと、「ゲームエンジンに対して実装してみました」というものが増えているように思います。例えばモーションの研究であれば、実際に動かす部分をUnityで作った研究が以前よりも多くなっており、CGの研究者がゲームを自然に使えて、研究の対象にもどんどんなってきていますので、今ではゲームを生かした研究がよりしやすくなっています。

三宅:学会のレベルは、毎年すごくレベルが上っていますよね。我々の学会は300人弱の中程度の規模ですが、研究が育まれていてレベルがどんどん上がったり、新しい研究が出てくるのが、日本デジタルゲーム学会の面白いところだなと思いますね。それでは、これが最後の質問です。おふたりの研究分野について、それぞれの今後の展望についてお話をいただけますでしょうか?

今給黎:現代はゲームエンジンが非常に発達していますので、ゲームを作ろうと思ったら、まずはゲームエンジンをダウンロードして、インターネットで使い方を調べながら気軽にゲームが作れるようになってきています。同時に、ゲームエンジンそのものに関する研究をする土壌もどんどん整備されていますので、今後はゲームエンジンをひとつの核として、誰もが実装するのは比較的面倒な部分がすでにある環境のうえで、さらにそのプラスアルファのある環境で、いろいろな研究が進んでいくのかなと思います。

良い面も悪い面もあるかと思いますが、おそらくその応用的なもの、例えばゲームに必要な本当の技術とは何なのかといったピンポイントで的を絞ったテーマが、実際のゲームにより出てきそうなテーマの研究が広がっていくのではないでしょうか。

三宅:そうですね。まさにゲームエンジンによって、大学でのゲーム研究が非常に進んだところがありますよね。

伊藤:今日は比較的カジュアルな話をしてきましたが、ゲームテクノロジーのコアなところをズバッと言いますと、三宅先生も今給黎先生も同意していただけるとうれしいのですが、例えば声や効果音の管理、あるいは音楽を動的に制御する管理など、音の分野においてはいずれもデジタル処理のなかでは、時間の制御がものすごく難しいんですね。デジタルゲームは、ただ静止画を1枚見せるタイプのコンテンツではなく、インタラクティブに切り替わり、なおかつ時間の制御も必要なもので、さらに言えば空間の表現、処理も難しいものですから、時間というものをデジタル技術のなかでどのように制御していくのかがとても難しいわけです。

以前にも三宅先生とお話をしたことがあったのですが、例えば1枚の静止画を作って表示させるようなAI、機械学習が今では非常に発達していますが、ミリセカンドるいは分や秒単位での時間セグメントを考えたうえでの、例えば時系列の処理のようなものは、まだまだチャレンジングな面が大きく、そして音の表現はこの部分とは切っても切れない関係にあるわけです。

絶対値のミリセク単位でのタイマーを回しての時間ではなく、ゲームとは言わば体験ですから、主観的時間というものが必要となってきますよね。「ここは緊張感あって、時間がものすごく長く感じる」とか、「ここはすごく爽快で、時間がどんどん進むように感じる」とか、コンピューターがミリセクを正確に計ればいいという、人間が関わらない工学の世界はもちろんのこと、それを人間がどういうふうに時間を感じるのかが切っても切れないところに、デジタルゲームは領域がきてしまっていると。

技術的には、そこに何かのブレイクスルーが起きて、人間の主観的な時間といかにマッチングする技術がうまく生まれるか? サウンド研究をする者のひとりとして、そこが大きなブレイクスルーになるのではないかと考えております。

今給黎:アニメーションの分野でも、似たようなことが起きていますよね。例えばカッコイイ場面同士を選んでつなぐとか、最新の技術ではAIを使って、それをどう管理するのかという研究を行なっています。人間がいかに自然な動きをするのか、より人間らしい動きをしているものを作り出せるのか、いわゆるモーションマッチングで綺麗につなぐということが積極的に研究されているのではないかと思います。

三宅:AI自体が、研究分野としてはまだ若い領域ですし、デジタルゲームAIの研究はもっともっと若い、まだまだこれからの分野です。ただ、大きな分岐点としては、機会学習をどこまで取り入れるのかが今後の大きな課題で、今まではトラディショナルなAIの研究をどれだけ取り込むのかだったのに対して、これからは記号主義的なトラディショナルなものと機械学習とをどうやってミックスしていくのかみたいなところが、これからは新しい分野として出てくるだろうなと思いますね。